お知らせ

ChatGPTの医学分野への応用[そうだったのか! ChatGPT 医師が知っておきたい話題と活用法(4)]

1.生成AIと第4次AIブーム

2000年代に登場した深層学習(ディープラーニング)技術は人工知能(AI)研究に大きな影響を与えました。そして,高性能の画像処理装置(graphics processing unit:GPU)が安価で利用可能になったこと,また,ビッグデータ時代の到来で大規模データの利活用が進んだことなどの環境的要因も影響し,第3次AIブームと呼ばれる,AI研究活況の時代が到来しました。第3次AIブームが過去の第1次および第2次AIブームと一線を画する点は,単に基礎研究レベルではなく,AIの社会実装が進んだということです。空港の顔認証などのセキュリティ分野や自動翻訳・自動音声認識,また,一般の家電製品に至るまで,社会で幅広くAIが活用される時代となっております。医療分野も例外ではなく,AIを利用した医療機器プログラム(software as a medical device:SaMD)の開発が世界中で進み,日本を含む多くの国々でAIの実臨床応用が進んでおります1)。

一方で,近年ChatGPTに代表される生成AI(ジェネレーションAIとも呼ばれる)が急速に進歩しており,AI研究領域のみならず社会全体にも大きな影響を及ぼすようになってきております。専門家の中には,生成AIの進歩に起因してAI技術が大きく注目されている現状から,第4次AIブームに入ったと認識されている方もおられます。そこで,本総説では現在注目されているChatGPTを中心とした生成AIに関して,特に医療分野への応用に焦点を当て,現状,課題および将来性に関して紹介したいと思います。

2.生成AIの進化とChat GPTの登場

AIの深化と生成モデルへの期待

1956年米国ダートマス大学で開催されたダートマス会議において,ジョン・マッカーシーらにより「artificial intelligence(人工知能)」という用語が学術用語として使用されて以来,世界中で活発にAI研究が進められてきました。しかし,その歴史は決して順風満帆ではなく,「AIブーム」と呼ばれるAI研究活況の期間と,「AI冬の時代」と呼ばれる,人々のAIに対する過剰な期待に対して技術的に応えることができず,失望に繋がったことによりAI研究が冷遇される期間を,繰り返してきました。その後,21世紀に入り,深層学習技術の登場は,AIが人手を介さず特徴量を抽出することができるという点で,人間による知識表現の必要がなくなり,AI研究の大きなブレークスルーとなりました。

2015年のILSVRC(画像認識の精度を競うcompetition)において,Microsoftのグループが開発したAIは人間の能力を超える画像認識精度を示し,また,2017年にはGoogle DeepMind社が開発したAI(AlphaGo)が,囲碁の対局において世界トップ棋士の柯潔との三番勝負で3局全勝したことなど,AIが人間を凌駕する能力を示した報告が世界中で相次ぎました。この事実は,AI技術が社会に浸透する要因となり,上述のようにAIは現在医療を含む様々な分野で利用されております。

深層学習の登場に伴いAI研究が精力的に推進される中,敵対的生成ネットワーク(generative adversarial networks:GANs)や変分オートエンコーダ(variational auto-encoder:VAE)と呼ばれる生成モデルが2014年に登場し,データから特徴を学習することで,実在しないデータを生成したり,存在するデータの特徴に沿って変換ができるようになったりしました。また,2017年にはtransformerと呼ばれる深層学習モデルが開発されましたが,このtransformerの開発により大規模な生成モデルの実現が可能となり,2018年6月にgenerative pre-trained transformer(GPT)がOpenAIより発表されました。

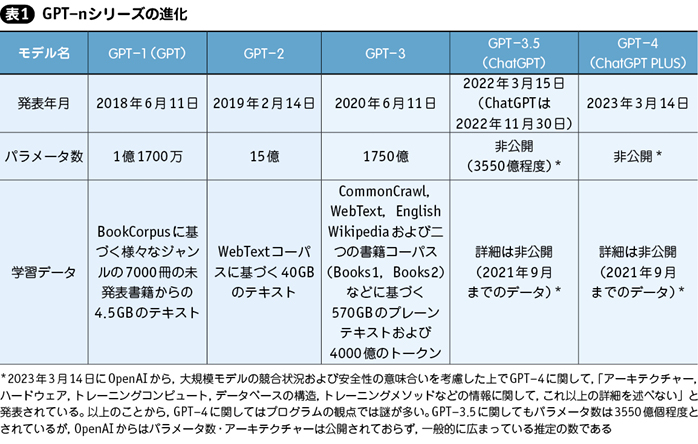

OpenAIとは,米国サンフランシスコを拠点とする,AI専門の非営利研究機関およびAI研究開発企業です。2019年2月にはOpenAIからGPT-2が発表され,GPT-1(GPT)と比してパラメータ数は1億1700万個から15億個と10倍程度増加しております(表1)。また,注意点として,OpenAIが開発したGPT-nシリーズは,生成AIモデルの中でも自然言語処理で活用される大規模言語モデル(large language models:LLM)というモダリティとなります。生成AIモデルは自然言語処理分野以外でも,画像(DALL-Eなど)やコンピュータープログラム(OpenAI Codexなど)など様々な分野で活用され医療応用にも試みられておりますが,誌面の都合上,本総説では,自然言語処理分野に限定して紹介して参ります。

chat GPTの登場と社会に与えた影響

2020年6月11日にはOpenAIからGPT-3が発表され,パラメータ数はGPT-2の100倍以上の1750億個となっており(表1),高い自然言語処理能力を実現させることに成功しました。直前の単語から次にくる単語を高い精度で予測することができるようになりましたので,人間が入力した文を受け取り,適切な出力文を返すことも可能となりました。他方,GPT-3が発表された時点では,LLMとしてのGPT-nシリーズは,まだAIの専門家以外にはあまり注目されていませんでしたが,2022年11月にChatGPTがOpenAIより一般公開されたことにより,世界中で大きく注目されることとなりました。

ChatGPTの基盤となるモデルであるGPT-3.5のパラメータ数は3550億個程度とGPT-3の2倍程度で,モデル自体に大きな進化はありませんでしたが,Chatというインターフェースで専門家でなくても利用できるようなUI/UXにしたこと,また,人間のフィードバックによる強化学習(reinforcement learning from human feedback:RLHF)を導入することで,一般の方々が違和感を覚えず使用できるようになりました。この点がChatGPTが世界中で大きく広まった要因であると考えております。さらに,2023年3月にはOpenAIはGPT-4を発表し,月額20ドルの有料サービスであるChatGPT PLUSを契約すれば(図1),GPT-4が利用できるようになりました(ChatGPTは無料)。GPT-4の能力に関してですが,GPT-3.5においては,司法試験の問題を解かせたところ下位10%程度のスコアしか出せなかったのですが,GPT-4は上位10%のスコアを記録したことが報告されています。また,最新の報告では日本の医師国家試験の問題をGPT-4に解かせたところ,合格水準であったことも報告されております2)。

このように精度の高い生成AIモデルが登場したことにより,世界中でChatGPTを中心とした生成AIモデルに注目が集まり,日々ニュースで報道されるなど一種の社会現象になっております。このような中,2023年6月8日に総理大臣官邸で開催された「総合科学技術・イノベーション会議」において,「生成AI」について,可能性とリスクのバランスを考慮しながら,利活用を強化していくことが発表され,その内容は「統合イノベーション戦略2023」に盛り込まれ,2023年6月9日に閣議決定されました3)。また,2023年6月26日に開催された「AI戦略会議(第3回)」において,これまで各省庁が分野ごとに作成してきたAI利活用ガイドラインを統合し,開発者や利用者が参照しやすい形にするという方向性を示すとともに,生成AIにより容易に作成される可能性がある「偽情報」が,SNSなどを使って国内で拡散された場合に備える体制も整備すべきという認識も示されました4)。

3.ChatGPTの医学分野への応用

医学分野への応用に関する現状

ChatGPTの医学分野への応用に関してですが,医学関連分野の最大級のデータベースであるPubMEDに“ChatGPT”と入力すると968件がヒットします(2023年8月5日時点)。最初に報告された論文が2022年12月であることから,非常に新しい医学研究分野であることがわかる一方,数カ月の間に既に1000報近くの論文が発表されていることから,注目されている研究領域であることもわかります。発表された論文の内容に関しては,医薬品開発,文献レビューの作成,診断書の改善,医療情報の提供,研究活動の改善,データ分析および個別化医療に焦点を当てたものなど,多岐にわたります。また,これらの論文から得られた情報をまとめて考察した結果として,ChatGPTは医学分野を革新する可能性を持っていることが示唆されたと考えられます。

一方で,研究や臨床の現場でChatGPTを広範に応用する前に,正確性,独創性,偏り,悪用への対策を強化し,学術的完全性,プライバシー,倫理に関わる問題を克服するためのさらなる取り組みが必要であることも,数多く議論されております。本件に関しては,ChatGPTはそもそも医学研究や医療に応用するために明確に開発されたものではない,ということに注意しなければならないと考えております。そのため,病気や治療のメカニズムの根底にある科学的・医学的知識において,必要な深みが欠けていると私は判断しております。

【編集部より】本連載では,過去に下記のテーマを扱っています。

▶ 実際にやってみた事例 ① ─ 医師のための「ChatGPT」基本のキ(原田 洸先生)

残り2,487文字あります

会員登録頂くことで利用範囲が広がります。 » 会員登録する